產業觀點

語音客服為何正在回歸:AI Voicebot 如何讓語音第一次變得可規模化

10 mins read

摘要

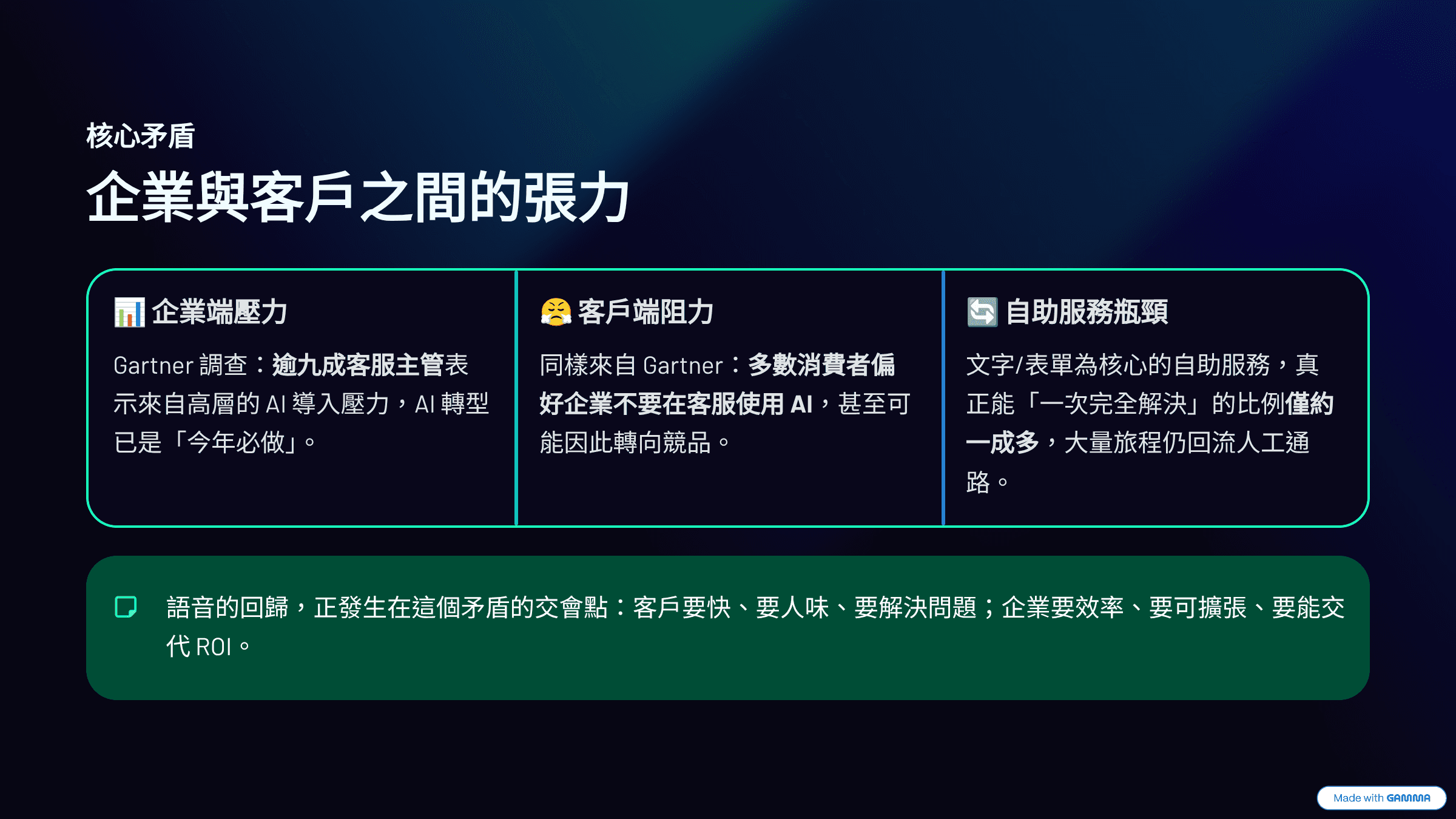

在 2026 年,客服通路正被兩股力量同時拉扯:一方面,Gartner 的調查顯示,客服主管承受強烈的 AI 導入壓力(九成以上表示來自高層的壓力),AI 轉型被視為「今年必做」而非「可做可不做」。 另一方面,同樣來自 Gartner 的客戶端調查卻指出,多數消費者更希望企業不要在客服使用 AI,甚至可能因為得知企業要用 AI 而轉向競品;而且自助服務(多數以文字/表單/知識庫為核心)真正能「一次解決」的比例仍偏低。

「語音客服的回歸」就發生在這個矛盾裡:客戶要快、要人味、要能解決;企業要效率、要可擴張、要能交代 ROI。跨通路行為也讓現況更複雜:在Microsoft 的全球研究中,受訪者多半會使用多個通路解決同一件事,而且語音仍是偏好的聯絡方式之一。

因此,這篇文章的核心命題是:語音不是回到過去,而是 AI 讓語音第一次變得可規模化——能用更低的邊際成本處理高頻需求、能用一致的品質控管體驗、能把「說話」接進企業系統與流程,並以風險治理框架去管理可靠性、隱私與詐騙風險。

語音回歸不是倒退:可規模化的關鍵轉折

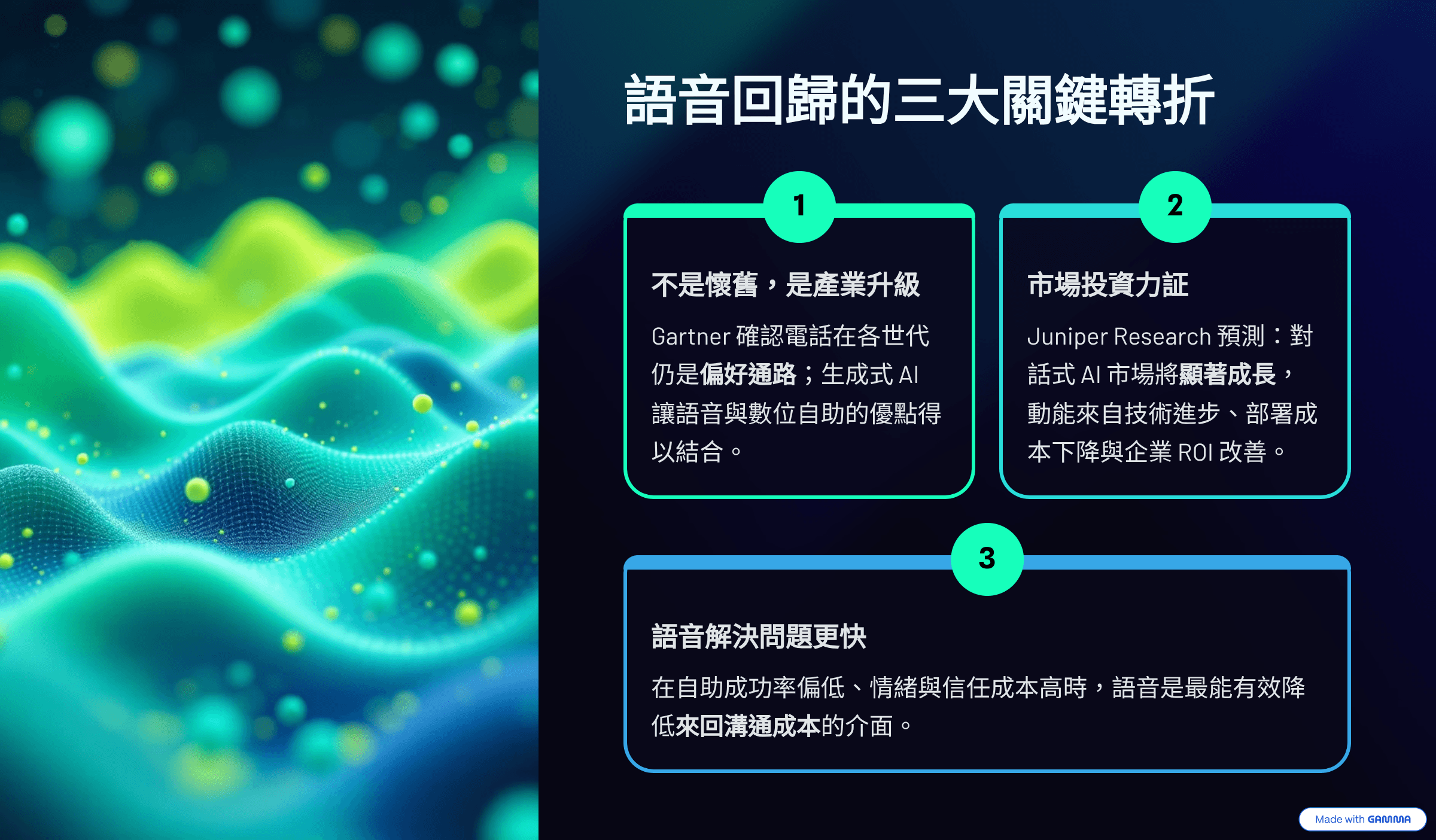

語音通路的「回歸」並不等於企業放棄數位化;更精準地說,是企業開始把語音重新視為「可被工程化與系統化」的通路。Gartner 在客服趨勢與預測中點出:企業長期嘗試把客服從傳統電話轉向數位通路,但電話在各世代仍是偏好的通路;生成式 AI(尤其是語音互動)提供一種可能,把語音與數位自助的優點結合,同時也引入更高的詐騙風險管理需求。

市場的投資預期也支持「不是懷舊,而是產業升級」:Juniper Research 的預測指出,對話式 AI 市場營收在未來數年將顯著成長,並把成長動能歸因於技術進步、部署與管理成本下降、以及企業 ROI 改善等因素。

更關鍵的是:語音回歸的「理由」並不是「大家突然更愛打電話」,而是「在某些條件下,語音比文字更能解決問題」。當自助服務成功率不高、客戶需要快速釐清、情緒與信任成本升高時,語音反而是能有效降低來回溝通成本的介面;而生成式 AI 的角色,是把這些優勢以更低成本、更可控的方式大規模交付。

為什麼企業曾想弱化語音:成本與體驗的結構性矛盾

企業過去「想要減少語音」的動機很現實:語音客服高度依賴人力,成本結構通常比文字/表單更不利;同時,語音中心的管理文化長期被「效率指標」主導,容易把體驗問題簡化為「縮短通話時間」。在ICMI 的產業調查中,聯絡中心最常追蹤的指標包含放棄率與平均處理時間(AHT)等效率指標,顯示管理重心常被量化效率牽引。

但「弱化語音、加碼自助」並沒有如理想般順利。Gartner 的調查指出,自助服務能「完全解決」的比例僅約一成多;即使是客戶自認「非常簡單」的問題,自助完全解決的比例也仍有限,代表大量旅程最後仍會回到有人協助的通路(例如電話或 email)。 這種現象會讓企業陷入「體驗與成本雙輸」:客戶先被迫自助(未解決)再轉人工,造成重複敘述、重複驗證與跨通路等待,最終把成本推回語音中心,同時惡化滿意度。

當企業把生成式 AI 帶進客服時,矛盾更尖銳:客戶端對「AI 取代人」高度敏感,且最直接的焦慮之一就是「更難找到真人」。Gartner 的調查明確指出,多數客戶偏好企業不要用 AI 進行客服,且有顯著比例會因此考慮轉向競品。 這意味著:如果 AI 被用來「擋住真人」,可能短期降低成本、長期提高流失;反之,如果 AI 被用來「加速解決與更快接到對的人」,才可能同時改善成本與體驗。

為什麼語音從未消失:偏好、信任與複雜問題

語音從未消失,因為它在「人類溝通」的本質上佔有優勢:同步、可即時回饋、能處理模糊與情緒,而且在某些情境下是最低摩擦的輸入方式。從消費者偏好看,Qualtrics XM Institute 的全球研究指出,「與自動化系統聊天」在多種互動情境中是最不受偏好的通路,平均只有約一成受訪者偏好使用。

另一方面,語音在實務上也仍然「被大量使用」。Microsoft 的研究顯示,電話/語音仍是受訪者最常使用的客服通路之一,並列出語音、email、線上自助與即時聊天等通路的使用比例。 更重要的是,受訪者往往需要跨多個通路才能解決問題,代表多數企業面對的不是「選語音或選文字」的二選一,而是「如何避免跨通路摩擦」。

把這些數據放在一起,你會得到一個對決策者更有用的結論:語音真正的價值,不在於它是最潮的通路,而在於它能在關鍵時刻降低客戶努力(effort)與縮短釐清成本。這也呼應了客戶體驗領域一個被廣泛引用的洞察:降低客戶為了解決問題所付出的努力,往往比「刻意取悅」更能推動忠誠與後續行為。Harvard Business Review 曾以 Customer Effort Score(CES)的觀點說明,努力程度在預測行為上可能優於單純滿意度或推薦等指標。

因此,語音的回歸不是「回到電話年代」,而是「在高摩擦、高不確定的互動上,重新選擇更省力的介面」——而 AI Voicebot 的角色,是把這個介面做得更可靠、更一致、更可被量測與優化。

讓語音變得好用又能擴張的技術底座

語音互動要能規模化,至少需要三個技術模組成熟並整合:語音轉文字(ASR/STT)、文字轉語音(TTS)、以及能理解語境並連接企業系統的語言模型與流程編排。

首先,在語音理解端,近年研究顯示大型資料與弱監督訓練能顯著提升語音辨識的泛化與穩健性。例如OpenAI 的 Whisper 研究指出,透過大規模多語言與多任務資料訓練,模型在多個基準上具競爭力,並以「接近人類」的準確性與穩健性作為研究結論之一。 同時,McKinsey & Company 的客服研究也指出,大型語言模型等生成式 AI 能處理非結構化的文字或語音,開啟客服技術的新可能。

其次,在語音生成端,學術界已展示「高自然度、可個人化」的 TTS 技術路線。例如 VALL-E 的研究提出以神經音訊編碼(neural codec)與語言模型方式做 TTS,並展示只需要極短的聲音提示就能生成具有說話者特徵的語音、且可保留情緒與環境特徵等能力。 這類能力一方面讓語音互動更自然,另一方面也直接提高了「語音詐騙」與身分偽冒的風險,因為攻擊者取得少量音訊素材就可能用於合成相似聲紋。

第三,真正讓語音「可規模化」的,不只是 ASR/TTS,而是把語音接到企業流程:驗證身分、查詢訂單、改期、建立工單、讀寫 CRM、觸發退款/補寄、或完成費用試算。這也是為何 Gartner 會把生成式 AI 視為降低多通路複雜度、促成更一致互動的一個支持點。

但必須誠實面對:語音 AI 仍可能在某些條件下產生嚴重錯誤。以「幻覺(hallucination)」為例,學術研究已在語音轉文字情境中量化其風險,指出即使模型平均準確,仍可能在小比例案例中產生完整捏造內容,且其中相當比例具有傷害性或引發誤解的風險。 這也是為什麼治理框架不可缺席:National Institute of Standards and Technology 的 AI 風險管理框架強調可信任 AI 的特性(如可靠、安全、可治理、隱私強化與公平性等),並提出治理、盤點、量測與管理等核心功能;網訊的 Telli 則針對生成式 AI 的配套治理流程也特別開發了AI QA智能質檢管理,供組織在不同營運週期階段採取行動。

什麼情境語音比文字更有優勢:企業決策框架

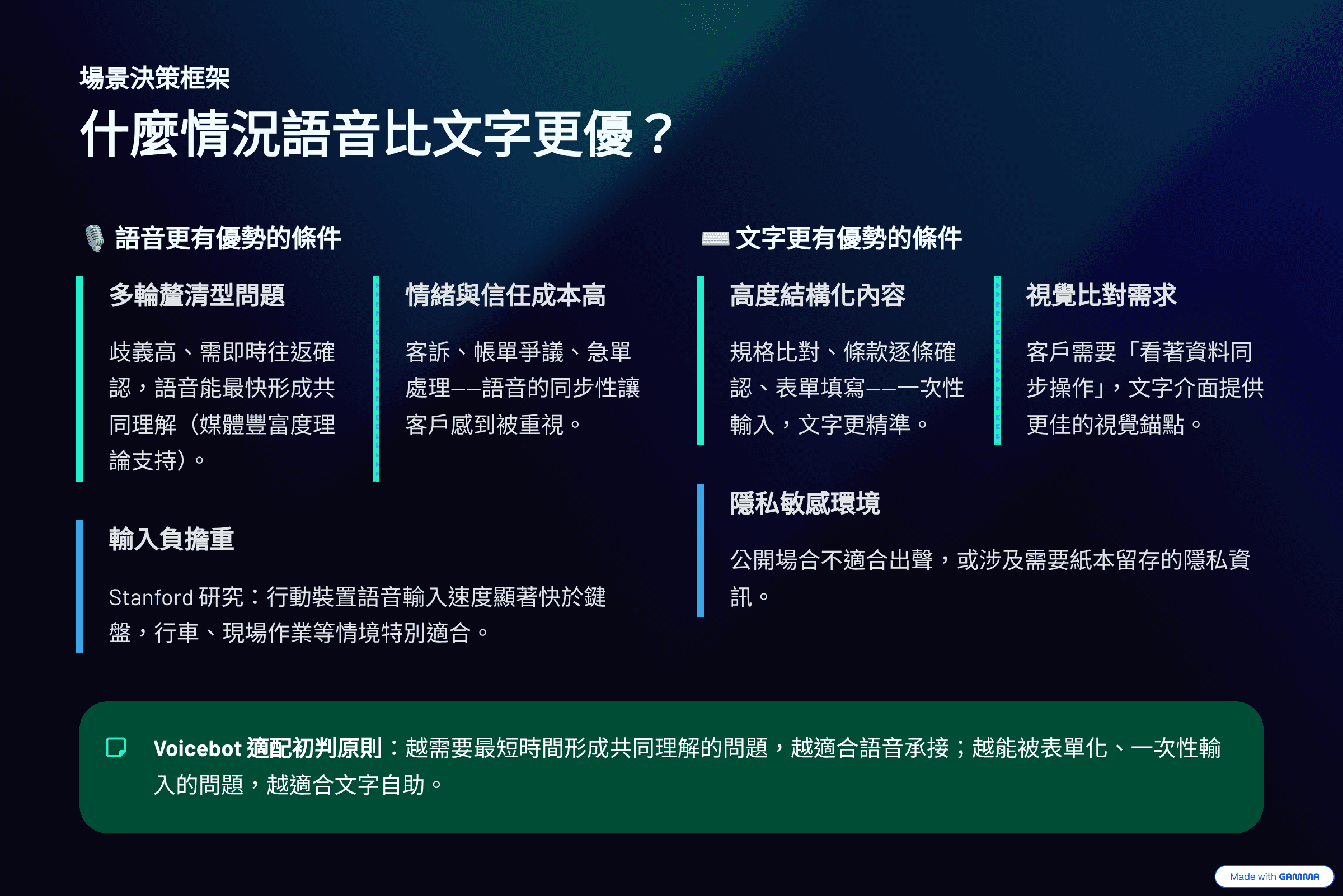

最重要的一句話其實是:不是大家都在用語音,而是要知道什麼條件下語音更優。這裡提供一個能直接用於 B2B 決策的框架:用「問題特性」決定「最佳介面」,再決定「是否由 Voicebot 承接」。

從學術溝通理論的角度,媒體豐富度(media richness)相關研究指出:當訊息「模糊、歧義高、需要快速往返釐清」時,較豐富、能即時回饋的媒介更能促成共同理解;相對地,例行、可標準化的訊息,較「精簡」的媒介也足夠。 把它映射到客服就是:越需要最短時間形成共同理解的問題,越適合用語音;越能被表單化、一次性輸入的問題,越適合文字自助。

同時,語音還有一個非常務實、可量化的優勢:在行動裝置上,「說」常常比「打字」更快。Stanford University 的人機互動研究指出,在智慧型手機輸入情境中,語音輸入速度可顯著快於鍵盤輸入,且在部分語言下錯誤率也更低。 這讓語音在「低手部可用性」或「高時間壓力」的情境特別有價值,例如行車、搬運、現場作業、或需要邊查邊說明的故障排除。

綜合上述,你可以用下列準則判断語音更可能勝出(每一點都同時是「Voicebot 適配度」的初判):

語音更有優勢的典型條件是:問題需要多輪釐清、帶有情緒或信任成本、需要即時回饋、或客戶輸入負擔很高(描述一串資訊、或不方便打字)。

文字更有優勢的典型條件是:內容高度結構化、需要視覺比對(例如規格表、條款逐條確認)、或涉及隱私而使用者所處環境不適合出聲。

最後,一個經常被忽略但在 2026 特別關鍵的提醒:不要把 Voicebot 當成「把真人拔掉」的工具。Forrester 的 2026 預測強調,多數組織尚未準備好交付「AI-first」客服願景,真正會發生的是大量基礎建設與變革管理;若過度自動化複雜或高情緒議題,服務品質可能下滑並惹怒客戶。

ROI 與風險治理:導入 AI Voicebot 的算帳方式與紅線

企業導入 Voicebot 最常見的失敗,不是模型不夠強,而是「算帳方式錯了」或「治理缺席」。在高層被要求 2026 必須導 AI 的環境下,Gartner 指出客服主管的 AI 導入壓力顯著升高;但同時市場也提醒:若缺乏清晰的商業價值與成熟度,許多看似進階的 AI 專案可能被取消。

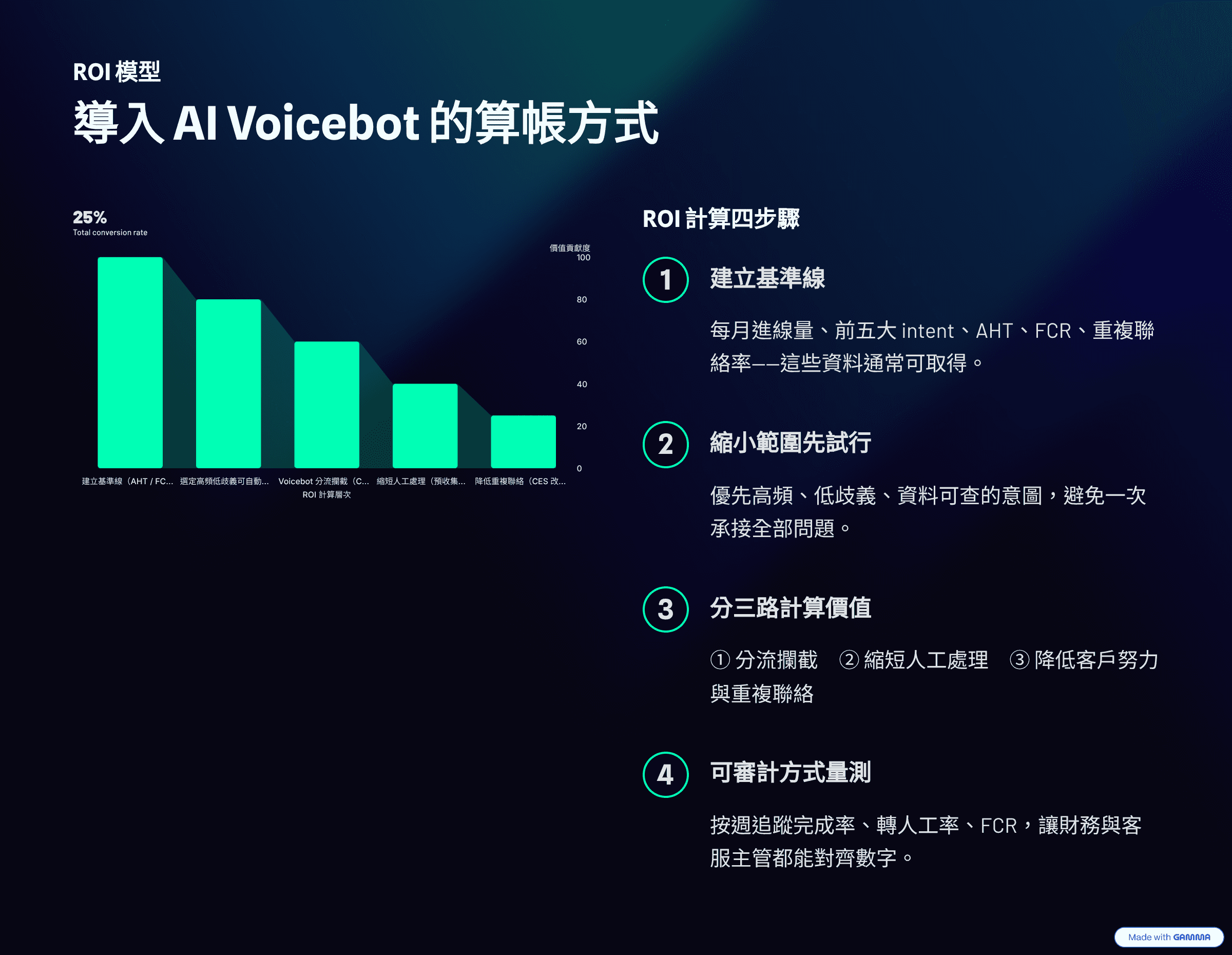

ROI 怎麼算才不會自我感動

建議把 ROI 拆成「節省成本」與「避免損失/創造價值」兩路並行,並以可驗證指標收斂:

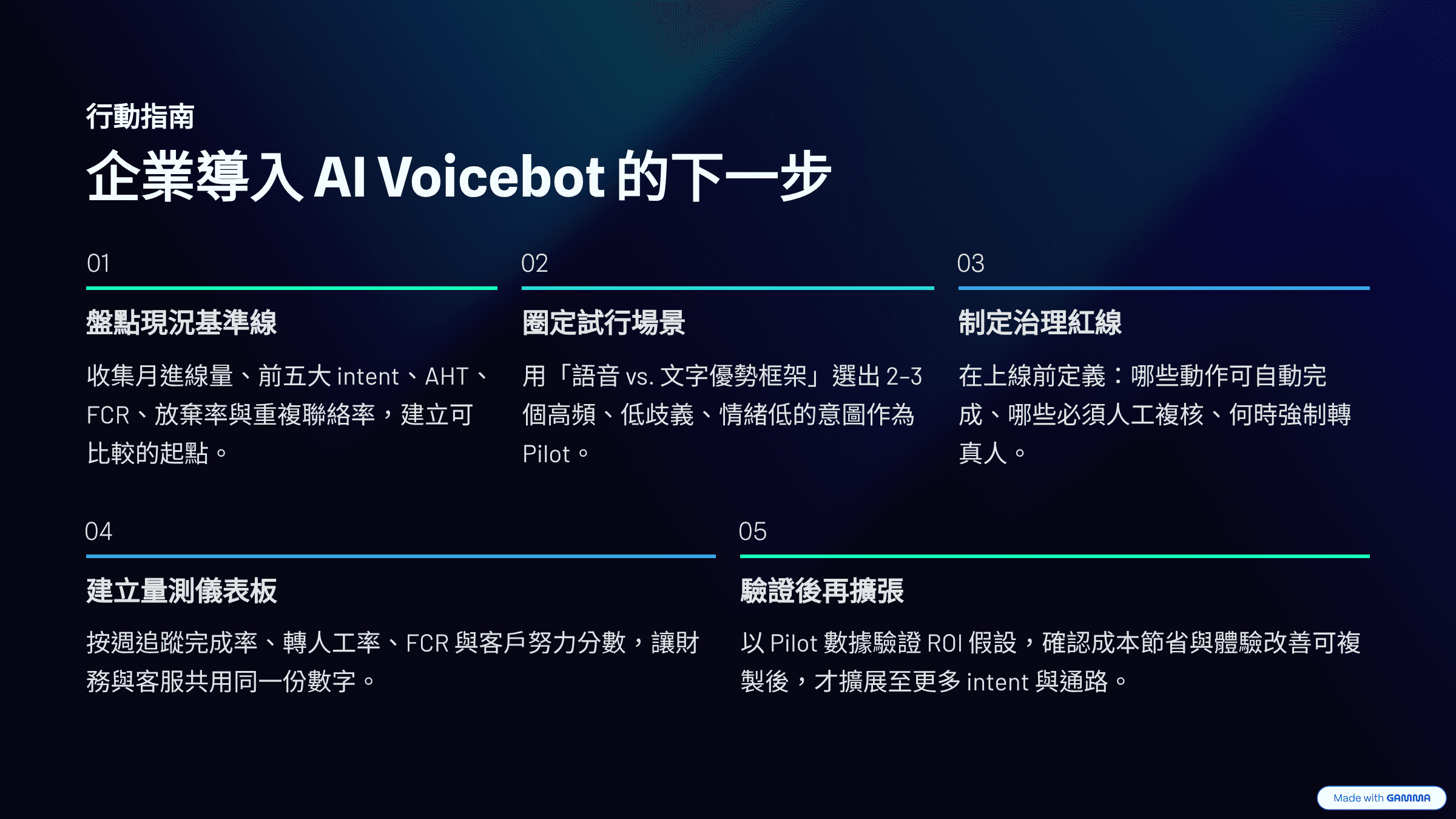

建立基準線:每月語音進線量、Top 10 來電原因/分類、平均處理時間(AHT)、一次解決率(FCR)、重複來電率、放棄率、以及轉接/升級比例。以產業現況來看,AHT 等效率指標普遍會被追蹤,這些資料通常可取得。

選擇可自動化、可驗證的範圍:優先從「高頻、低歧義、資料可查、流程可觸發」的意圖開始,避免一開始就想承接所有問題。這是因為自助服務完全解決率偏低的現實,意味著「混合式旅程」極常見;一開始就全自動,往往只會把問題推到更昂貴的人工通路。

把 Voicebot 的價值拆小:

分流/攔截(containment):成功在語音端完成查詢或變更,少一通人工。

縮短人工處理:即便最後轉人工,Voicebot 先收集資訊、驗證、摘要,減少人工重問與重打字。這類「窄任務自動化」是McKinsey & Company 所描述的生成式 AI 在客服應用中常見方向之一(支援座席、後台分析、決策等)。

降低客戶努力與重複聯絡:以 CES 的觀點,降低努力往往能更有效地影響後續行為,並減少不必要的聯絡成本。

用「可審計」的方式量測:對同一個來電原因/分類,按週追蹤完成率、轉人工率、FCR、重複聯絡率、與客戶努力/滿意等指標;把改善寫進儀表板,讓財務與客服都能對齊。

什麼情況不適合導入或不該由 Voicebot 承接

Voicebot 不適合承接的典型紅線,是「錯一次就很昂貴」或「需要高度同理、授權與判斷」的情境,尤其當組織無法提供足夠的治理與人工兜底時。Forrester 已提醒,過度自動化複雜或高情緒需求會造成反效果。 同時,語音轉文字的研究也指出:即便平均表現良好,仍可能在小比例案例產生「整段捏造」的幻覺內容,且其中相當比例具有潛在傷害性,這在醫療、金融、法務、或任何高風險決策場景都必須非常保守處理。

場景 | 優勢 | 是否適合 Voicebot |

|---|---|---|

訂單/帳單/進度查詢(高頻、明確) | 快速檢索+即時回覆,降低人工接線量 | 適合(先做) |

改期/取消/退貨(規則清楚、需確認) | 語音多輪確認可降低填表摩擦 | 適合(需嚴格核對) |

帳號驗證/重設密碼(需安全) | 以流程化問答完成身分核驗與導引 | 視風險(高風險需升級/複核) |

故障初診與分流(需要釐清) | 語音可快速蒐集症狀、摘要給座席 | 適合(以座席增能為主) |

高情緒客訴/合約爭議/例外處理 | 需要同理、授權與判斷 | 不建議(優先真人) |

治理怎麼做才能把風險變成可管理成本

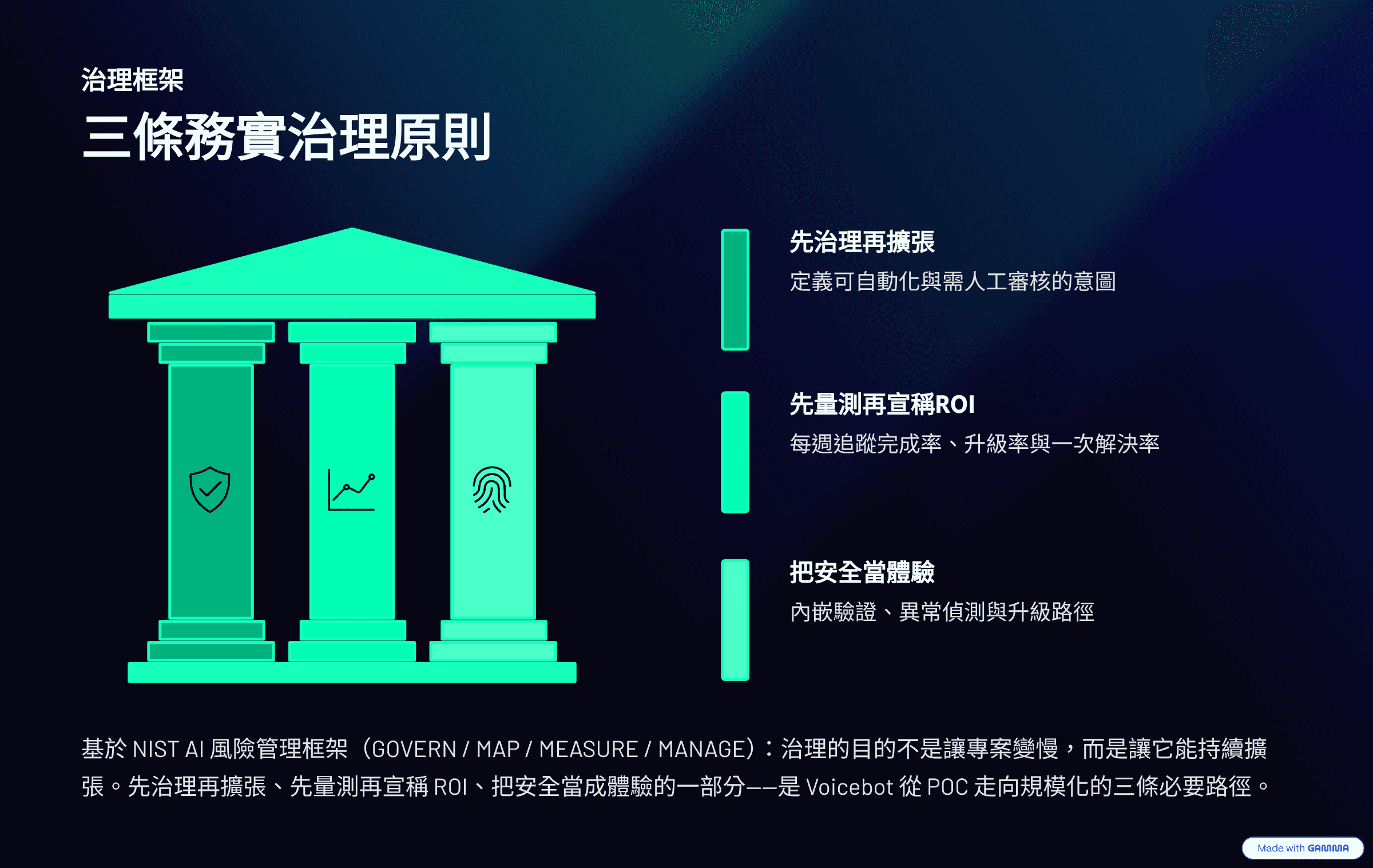

治理的目的不是讓專案變慢,而是讓它能擴張。NIST 的 AI RMF 強調可信任 AI 的特性,並提供 GOVERN / MAP / MEASURE / MANAGE 的工作切面;其生成式 AI 配套文件則把「生成式 AI 特有或被放大的風險」整理成可執行的建議行動。

把它翻譯成 Voicebot 導入語言,可以落在三條務實原則:

(1) 先治理再擴張:定義哪些意圖與動作可以自動完成、哪些必須人工複核、何時一定要轉接真人,採用合適的人機協作平台,避免「為了自動化而自動化」。

(2) 先量測再宣稱 ROI:避免把「demo 很順」誤當「規模化可行」。市場上對「AI 專案被取消」的警示,很多時候就是因為價值不清與落地成本高於想像。

(3) 把安全當成體驗的一部分:生成式 AI 讓語音互動更無縫,但 Gartner 也提醒伴隨更高的詐騙風險;因此需要把驗證、異常偵測與升級機制視為產品體驗的一部分,而不是資訊部門的附加項。

語音客服的回歸,本質上不是通路戰爭,而是「在自助成功率受限、客戶信任敏感、企業被迫導 AI」的交會點,重新用工程化的方法設計最省力的互動介面。當 AI Voicebot 被定位為「降低努力、加速解決、把語音接上流程」的系統,而不是「擋住真人」的牆,它才會真正成為 2026 之後可複利擴張的客服能力。

如果您的企業正評估客服自動化,建議先挑選「高頻且規則清晰」的語音服務場景進行小規模實證,並同時量測客戶滿意度和處理成本。歡迎聯繫我們的顧問團隊,共享您的客服現狀與目標,我們能協助設計出「可量化 Voicebot 試點」,讓效率與體驗同時提升。

企業導入 AI Voicebot 的下一步

盤點語音服務場景

評估 ROI 與分流機會

設計 Voicebot Pilot

本文引用之研究與資料來源

Gartner(2026)新聞稿:Survey Finds 91% of Customer Service Leaders Under Pressure to Implement AI in 2026.

Gartner(2024)新聞稿:Gartner Survey Finds 64% of Customers Would Prefer That Companies Didn’t Use AI For Customer Service.

Gartner(2024)新聞稿:Only 14% of Customer Service Issues Are Fully Resolved in Self-Service.

McKinsey & Company(2024)研究報告:Where is customer care in 2024?

Qualtrics XM Institute(2024)白皮書:Global Study: Consumer Channel Preferences, 2024.

Stanford 大學報導(2016):Speech recognition faster at texting(註:研究顯示語音輸入比手動打字快 3 倍且更精確)。

NIST(2024)技術報告:AI RMF Generative AI Profile(來源受限,摘自 NIST AI 風險管理框架摘要)。

arXiv(2022)Robust Speech Recognition via Large-Scale Weak Supervision(Whisper, arXiv:2212.04356).

arXiv(2023)Neural Codec Language Models are Zero-Shot Text to Speech Synthesizers(VALL‑E, arXiv:2301.02111).

Reuters (2025) Over 40% of agentic AI projects will be scrapped by 2027, Gartner says

Forrester (2025) Predictions 2026: AI Gets Real For Customer Service — But It’s Not Glamorous Work

Management Science (1986) Organizational Information Requirements, Media Richness and Structural Design

What Contact Centers are measuring, according to the data (2025). 載於: https://www.icmi.com/resources/2025/what-contact-centers-are-measuring

Juniper Research (2025) GLOBAL CONVERSATIONAL AI MARKET 2025-2029

Microsoft 全球客服研究: Global State of Customer Service- The transformation of customer service from 2015 to present day

Dixon, Freeman, Toman (2010). Stop Trying to Delight Your Customers. Harvard Business Review.

Allison Koenecke, Anna Seo Gyeong Choi et al. (2024) Careless Whisper: Speech-to-Text Hallucination

*來源受限項目:**如 Gartner 與 Qualtrics 更完整的調查報告多數需付費訂閱,本文援引其新聞稿與公開摘要。